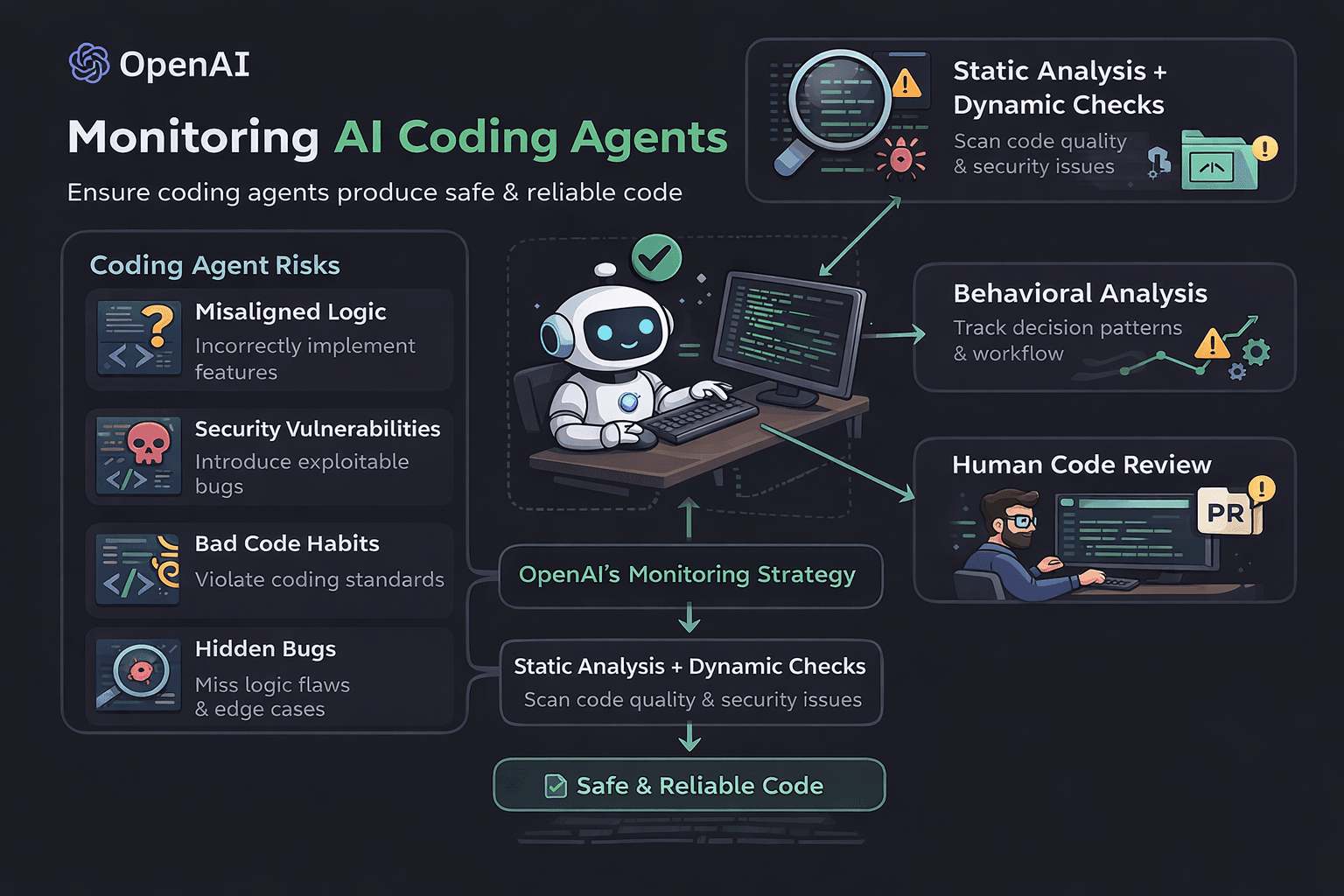

How we monitor internal coding agents for misalignment

OpenAI 最近發了篇技術文章,講他們怎麼監控內部的 coding agent,避免這些 AI 寫出有問題的程式碼。老實說這個話題比我想像的實用,不是那種遙遠的 AI safety 理論,而是「你的 AI 助手會不會搞砸你的 codebase」的現實問題。

問題定義:AI 寫程式會出什麼包?

首先要搞清楚什麼叫 misalignment。在 coding agent 的脈絡下,不是那種科幻電影裡 AI 要毀滅世界,而是更實際的:

- 偏離需求 — 你要它實作一個 API,它寫出來的邏輯根本不是你要的

- 引入風險 — 寫出有 security vulnerability 的程式碼

- 破壞架構 — 不遵守既有的 coding standard 或設計模式

- 隱藏問題 — 表面上能 run,但邏輯有漏洞或 edge case 沒處理

這些問題在人類工程師身上也會出現,但 AI 的問題是規模化 — 一個錯誤的 pattern 可能被複製到很多地方。

OpenAI 的監控機制拆解

他們的做法分成幾個層次:

1. 靜態分析 + 動態檢查

這部分比較標準,用工具掃 code quality、security issues、compliance。但關鍵是他們把這些檢查整合到 agent 的 feedback loop 裡 — 不是事後檢查,而是讓 agent 在寫程式的過程中就能收到這些信號。

我覺得這個思路不錯,但實作上要注意 latency。靜態分析工具通常不快,如果每次 agent 要寫程式都要跑一輪 linter,整個開發流程會被拖慢。

2. 行為模式分析

這個比較有趣。他們會追蹤 agent 的「決策路徑」— 比如說給定一個任務,agent 選擇用什麼技術、怎麼組織程式碼、prioritize 什麼功能。

如果 agent 突然開始用一些奇怪的 pattern,或者對某類問題的處理方式跟平常不一樣,就會被標記出來。這有點像異常檢測,但專門針對程式設計的思路。

3. 人類 Review 流程

最務實的一層。他們設計了一套 escalation 機制 — agent 寫的程式碼會根據複雜度、影響範圍、confidence score 分級,高風險的一定要人類 review,中等風險的抽樣檢查。

這裡的 trick 是怎麼設計 confidence score。他們會看 agent 生成程式碼時的「猶豫程度」— 比如改了很多次、生成的 token probability 分布很平、對同一個問題給出很不一樣的答案。

實作建議:你的專案可以怎麼做

看完 OpenAI 的做法,我覺得有幾個點可以借鑑:

基礎版:整合現有工具

如果你已經在用 Copilot 或 Cursor,最簡單的做法是強化你的 CI/CD pipeline。加上:

- Pre-commit hooks 跑 security scan

- PR 自動檢查 code complexity 跟 test coverage

- 定期跑 dependency vulnerability scan

這些工具本來就該有,只是現在要更認真看結果。

進階版:自建監控

如果你的團隊有在用 coding agent 做比較複雜的任務,可以考慮:

// 簡化版的 agent output 檢查

const validateAgentOutput = async (code, task) => {

const checks = await Promise.all([

runStaticAnalysis(code),

checkSecurityIssues(code),

validateAgainstTask(code, task)

])

return {

riskLevel: calculateRisk(checks),

needsHumanReview: checks.some(c => c.critical)

}

}

關鍵是要記錄這些檢查的結果,時間久了就能找出 pattern。

團隊流程調整

最重要的其實是流程。建議:

- 明確定義 agent 的使用範圍 — 什麼任務可以全自動,什麼要人類檢查

- 建立 escalation path — 遇到問題時誰負責處理

- 定期 retro — agent 搞出過什麼包,怎麼避免

實際考量:成本 vs 效益

老實說,完整實作這套監控機制成本不低。OpenAI 有資源搞這麼複雜的系統,但大部分團隊可能不值得。

<h2>延伸閱讀</h2> <ul> <li><a href="/blog/anatomy-of-agent-harness">拆解 Agent Harness — 你以為的 AI Agent 其實 90% 是 harness</a></li> <li><a href="/blog/coding-agents-reshaping-epd">Coding Agent 正在改變工程、產品、設計的協作方式 — 但改變的不是你想的那個</a></li> <li><a href="/blog/thinking-fast-slow-and-artificial-how-ai-is-reshaping-human-reasoning">Thinking Fast, Slow, and Artificial: How AI Is Reshaping Human Reasoning</a></li> </ul>Waiting7777

WoW Arena 冠軍轉前端,用電競 meta 思維拆解技術趨勢。

這篇文章對你有幫助嗎?

每週一篇 — 技術趨勢背後的商業邏輯

AI 產業在變什麼、工程師該注意什麼——拆清楚寄到你的信箱。