模仿人腦的晶片來了,AI 耗電問題有解了?

劍橋的仿腦晶片聽起來很厲害,但真的能改變 AI 耗電問題嗎?

劍橋大學最近搞出了一個挺有趣的東西 — 仿人腦的晶片材料,說是能大幅減少 AI 的能耗。老實說,這類「仿生」技術的新聞我看了不少,大部分都是學術界的概念驗證,距離實際應用還有十萬八千里。但這次不太一樣,值得認真看一下。

為什麼 AI 這麼耗電?

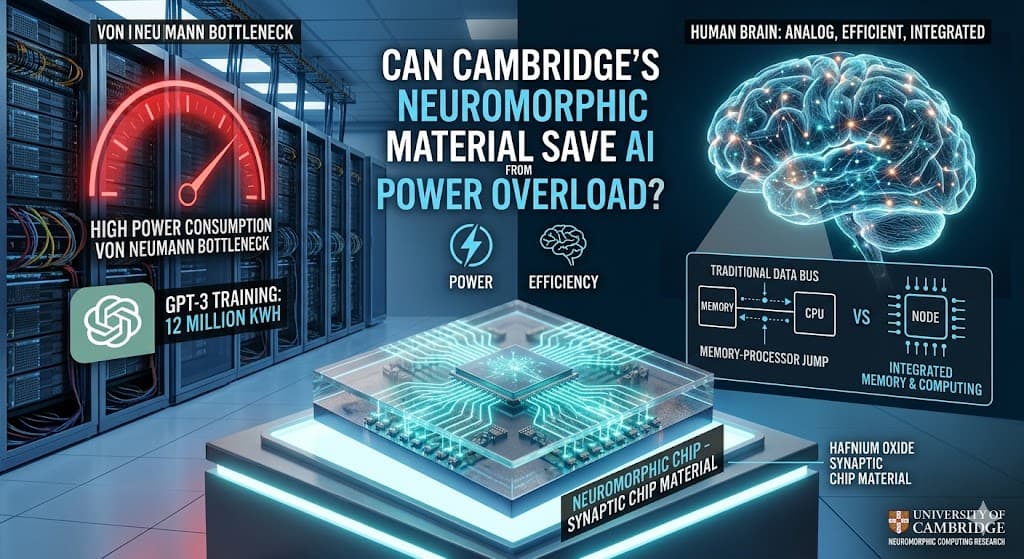

先說現況。現在的 AI 運算基本上是暴力美學 — 用傳統的 von Neumann 架構硬算,資料要在記憶體和處理器之間狂跳。ChatGPT 每次回答你一個問題,耗電量大概是 Google 搜尋的 10 倍。

更誇張的是訓練過程。GPT-3 當年訓練一次大概燒掉 1200 萬度電,夠一般家庭用 1000 年。而且這個數字只會越來越大 — 模型越大,耗電越誇張。Google、Microsoft 這些大廠現在光是 AI 就吃掉他們總電力的好幾成。

這不只是環保問題,更是成本問題。電費直接影響 AI 服務的獲利能力,也是為什麼大家都在搶便宜電力、往冰島或北歐蓋資料中心的原因。

人腦的「作弊」方式

人腦處理資訊的方式跟電腦完全不同。我們的神經元不是用 0 跟 1 的數位訊號,而是用類比的電化學反應。更重要的是,人腦的記憶跟運算是整合在一起的 — neuromorphic computing 的核心概念就是這個。

劍橋這個團隊做的事情,簡單說就是用材料科學模擬神經元的行為。他們用了一種叫做 hafnium oxide 的材料,可以改變電阻來「記住」之前的狀態,就像神經元的突觸一樣。

聽起來很抽象,但實際效果很直接:運算跟記憶在同一個地方發生,不用搬資料,自然就省電了。

實際應用的挑戰

問題是,這種材料要真正變成可用的晶片,還有不少技術債要還。

首先是穩定性。類比訊號比數位訊號難控制,溫度、濕度、老化都會影響性能。傳統晶片之所以用數位,就是因為 0 跟 1 比較不容易出錯。

再來是製造成本。現在的晶片製程已經很成熟了,從設計到量產的整套流程都有。要換成新材料,等於要重新建立整個 supply chain,這個轉換成本非常高。

最後是軟體生態。現在的 AI framework — PyTorch、TensorFlow 這些,都是針對傳統架構設計的。要支援 neuromorphic chip,軟體層要重新來過。

誰會先用?

我覺得最可能的應用場景是 edge computing。

現在大部分 AI 運算都在雲端,但越來越多場景需要在本地處理 — 自動駕駛、IoT 設備、手機的 AI 功能。這些場景對功耗特別敏感,電池續航力直接影響用戶體驗。

另一個方向是專用晶片。不用什麼都能跑,專門針對特定 AI 任務設計,比如影像辨識或語音處理。這樣可以避開通用性的問題,直接優化特定應用的效率。

真的能改變 AI 基礎設施嗎?

短期內,我是不太看好能大規模取代現有架構。技術轉換的門檻太高了,而且現在的晶片廠商 — NVIDIA、AMD、Intel — 都在傳統架構上投了太多錢,不太可能輕易轉向。

但長期來看,這個方向是對的。AI 的耗電問題只會越來越嚴重,不解決的話整個產業都會被電費拖死。neuromorphic computing 可能不是唯一解答,但至少指出了一個可能的方向。

更實際的影響可能是推動整個產業思考能源效率。就像當年手機逼出了 ARM 架構一樣,AI 的耗電壓力也會催生新的解決方案。劍橋這個研究雖然還在實驗室階段,但至少證明了仿腦運算不是空想。

關鍵還是看有沒有廠商願意投錢做下去。技術再厲害,沒人量產就是紙上談兵。

<h2>延伸閱讀</h2> <ul> <li><a href="/blog/thinking-fast-slow-and-artificial-how-ai-is-reshaping-human-reasoning">Thinking Fast, Slow, and Artificial: How AI Is Reshaping Human Reasoning</a></li> <li><a href="/blog/anatomy-of-agent-harness">拆解 Agent Harness — 你以為的 AI Agent 其實 90% 是 harness</a></li> <li><a href="/blog/building-nextjs-for-an-agentic-future">Building Next.js for an agentic future</a></li> </ul>Waiting7777

WoW Arena 冠軍轉前端,用電競 meta 思維拆解技術趨勢。

這篇文章對你有幫助嗎?

每週一篇 — 技術趨勢背後的商業邏輯

AI 產業在變什麼、工程師該注意什麼——拆清楚寄到你的信箱。